只需挥一挥手:3D手势识别系统

如果我们只需在空中挥一挥手就能达到目的,就像钢铁侠指挥他的人工智能系统网络一样,那该有多酷?这就像是终极的个人物联网。虽然手势识别和IT技术可能还没有达到科幻电影的水平,但正在接近实现这一目标。

事实上,手势识别技术市场预计将以22.2%的复合年增长率持续增长,到2025将成为全球市场规模达到306亿美元的产业1 。得益于手势控制系统在提升用户体验、减少驾驶员工作量和提高车辆安全性方面的潜在优势,汽车行业尤其在推动这一增长。

手势是人类交流和表达的一个自然而直观的部分。我们几乎不需要额外的智能处理就能够使用手势与周边环境中的设备进行通信。我们几乎可以不加思索地做到这一点。举例来说,在驾驶汽车时使用手势的好处在于,您只需从其他活动中分散最少的注意力用于打手势即可。相比之下,与触摸屏显示器进行交互时,驾驶员必须将视线从道路上移开,以在屏幕上进行精确的选择。

宝马7系在2016年引入了手势识别功能。驾驶员可以“调高或调低音量、接听或拒绝电话以及更改多相机视图的角度。甚至还有可自定义的两指手势,您可以对其进行编程”2,以响应您所需的任何命令,包括“导航首页”、“订购披萨”等。

汽车组件制造商Continental公司现在提供具有手势识别功能的系统,该系统与中控显示屏、仪表盘和方向盘集成在一起,使驾驶员只需用手轻轻一划或移动手指即可控制不同的功能。跟许多手势识别设备一样,该系统使用850-940nm范围内的近红外(NIR)光,并应用结构光和飞行时间(TOF)方法。

除汽车工业外,其他发展潜力较大的手势识别应用还包括医疗保健(例如:在手术室中启用无菌、免手动计算机界面)、制造业、手语识别以及供行动不便人士使用的辅助技术。

手势采集技术

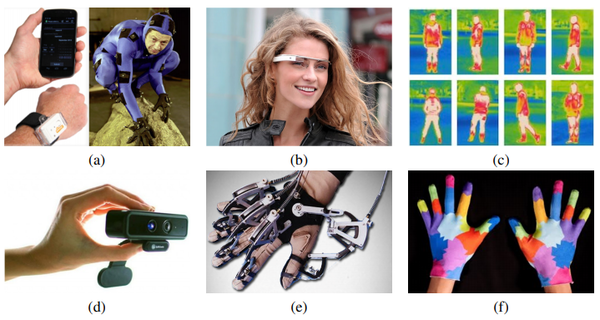

手势识别涉及多种元素的整合。第一步是“采集”手势,即以可以处理的方式采集人类的动作。我们可以通过基于设备的系统(例如:用户佩戴的手套控制器)来实现手势采集,这类系统通常使用某种类型的相机。视觉输入系统可以使用各种不同的技术,包括RGB、3D /深度感测、热成像等。

在20世纪80年代初期,随着有线手套的发展,计算机手势识别领域出现了。这种手套在指关节部位内置了传感器,称为数据手套。与此同时,基于视觉图像的识别系统应运而生,该系统依赖于读取固定在手套上的彩色面板3。

用于手势识别的采集设备示例:(a)左:带有GPD的手机和加速度计,右:惯性传感器,其中,加速度计和陀螺仪连接到Andy Serkis穿着的套装上,以在《指环王》系列电影中塑造Gollum的CGI角色,(b)谷歌眼镜,用于“以自我为中心”的计算,(c) 热图像,用于动作识别,(d) 音频-RGB-深度设备,(e)有源手套,以及(f)无源手套4(图片来源)

Microsoft Kinect是大众市场上出现的首款手势识别产品,它是用于Xbox®游戏系统的动作传感器附加组件。它使用RGB色彩VGA摄像机、深度传感器和多阵列麦克风来采集并响应玩家的动作。虽然消费类产品已逐步被淘汰,但动作感测平台仍以Azure Kinect品牌名称提供给开发人员。

虽然有线或基于控制器的手势采集系统仍在广泛使用,但人们对“非接触式”技术的关注正在增加1。在车辆驾驶员座位和医院手术室等环境中,无需触摸设备这一优点非常重要。

分步采集视觉图像

本质上,手势识别是通过计算设备对人类手势的一种数学表示。它需要一系列复杂的过程来采集、解读和响应人工输入。Marxent Labs概述了以下四个关键步骤:

第1步。相机采集图像数据并将其输入到与计算机连接的感测设备中。

第2步。专门设计的软件从预先确定的手势库中识别有意义的手势,其中每个手势都与计算机命令相匹配。

第3步。然后,该软件将每个实时手势相关联,解读该手势并使用手势库来识别与该手势库相匹配的有意义的手势。

第4步。对手势进行解读后,计算机将执行与该特定手势相关的命令。

Lumentum公司 描述了第1步中将使用的成像系统的关键要素:

照明源—通常产生红外光或近红外光的LED或激光二极管。“这种光通常不会引起用户的注意,并且通常经过光学调制以提高系统的分辨率性能。”5有些系统将2D彩色相机与3D感测(NIR)光源和相机组合使用。

控制光学器件—光学镜头有助于照亮环境并将反射光聚焦到探测器表面上。带通滤光片仅使与照明光线频率(例如940 nm)相匹配的反射光到达光传感器,从而消除了环境光及其他可能会降低设备性能的杂散光。

深度相机—高性能光学接收器可检测过滤后的近红外反射光,并将其转换为电信号进行处理。

固件—超高速ASIC或DSP芯片(也称为手势识别集成芯片,简称“IC”)处理接收到的信息,并将其转换为最终用户应用(比如视频游戏软件)可以理解的格式。

图像处理复杂性

虽然涉及到所有系统组件,但采集图像进行分析(第1步)可能是使手势识别系统正常工作的最简单方面。将信息解读为可行的人机交互模型是一项更大的挑战(第2步和第3步)。不同于面部识别只需将采集的静态模式与存储的静态模式进行匹配,手势识别需要对动态动作进行复杂的分析。

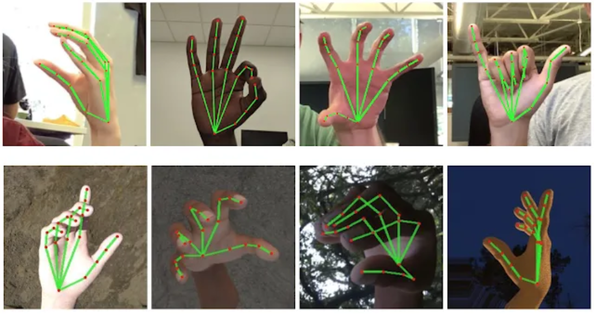

为了进行分析,我们可以将手势分解为多个元素:手部配置(手部形状)、方向、定位(位置)及其在空间中的移动。手势还可以粗略地分为静态(手部保持一种“姿势”)和动态(手部姿势随其移动而变化)。

骨骼型手势识别图像,其使用谷歌(Google)的开源开发人员算法,可使用智能手机提供实时手势识别工具。(图片来源:Mashable)

对各种手势进行评估、分类和解读是一项复杂的跨学科任务,需要将计算机视觉和图形、图像处理、运动建模、运动分析、模式识别、机器学习技术、生物信息学甚至心理语言学分析等方面结合在一起6,7。业界已尝试并组合了不同的方法来构建可行的计算机化手势分类模型,比如神经网络(NN)、时延神经网络(TDNN)、支持向量机(SVM)、隐马尔可夫模型(HMM)、深层神经网络(DNN)和动态时间规整(DTW)等8。

手势识别应用

尽管存在这些挑战,但仍有一些公司开发出了成功的手势识别系统,这些系统如今已在游戏、医学等多个行业中使用。举例来说,微软(Microsoft)与诺华(Novartis)合作开发了一种创新系统,用于评估多发性硬化症患者的身体机能硬化进展情况。在虚拟现实系统中,手部和手势追踪使用户能够与虚拟对象进行交互。

Leap Motion公司开发了一款传感器,其能够检测手部和手指运动。除了使用它来控制PC外,它还可以在虚拟现实中执行手部追踪,从而使用户能够与虚拟对象进行交互。

依靠NIR近红外光感测技术

当今使用的许多成功的手势识别技术系统都依靠近红外光(人类不可见)来照亮人类用户的动作。近红外光支持深度测量和3D感测功能,这些功能使用结构光和/或TOF方法来生成输入数据。为了确保基于近红外光的手势识别系统的准确性,近红外光光源(通常为LED或VCSEL之类的激光发射器)必须正确运行。手势识别系统制造商需要验证性能,以确保照明光源发出的近红外光强度足以使手势识别系统正常工作,并保证人体接触的安全性。

Radiant提供NIR近红外光辐射强度测量镜头解决方案,可对手势识别、面部识别、眼动追踪应用中使用的NIR发射器进行准确地测量和表征。该镜头与ProMetric®成像亮度计和TrueTest™ 软件搭配使用,提供完整的近红外光光源测量解决方案。对于面部识别和手势识别应用,TrueTest软件中的 TT-NIRI™测试模块包含特定的近红外光光源测量和测试,包括:

|

|

面部识别和手势识别系统都使用相同的结构光(点阵模式)和TOF测量3D感测方法。阅读Radiant的白皮书:“通过精确地测量近红外光(NIR)光源实现有 效的3D面部识别”,了解更多有关如何测试以人为本的技术中使用的近红外光(NIR)发射光源。

引用文献

- Gesture Recognition Market Size, Share & Trends Analysis Report By Technlogy (Touch-based, Touchless), By Industry (Automotive, Consumer Electronics, Healthcare), and Segment Forecasts, 2019-2015,Grand View Research,2019年1月。

- “Wendorf, M., “How Gesture Recognition Will Change Our Relationship With Tech Devices”,《趣味工程》(Interesting Engineering),2019年3月31日。

- “Historical Development of Hand Gesture Recognition”,第2章,Premaratne, P.,利用手势进行人际交互。 识别科学与技术, Springer 科学+商业媒体,新加坡,2014年。DOI 10.1007/978-981-4585-69-9_2。

- Escalera, S., Athitsos, V., 和 Guyon, I.,“多模式手势识别挑战”,《机器学习研究》杂志( Machine Learning Research),第 17期(2016年),第 1-54页。

- 3D Sensing/Gesture Recognition and Lumentum,白皮书发布在Lumentum.com上,2016年。

- Wu, Y., 和 Huang, T., “Vision-Based Gesture Recognition: A Review”。

- Sarkar, A., Sanyal, G. 和 Majumder, S., “手势识别系统:调查”,《计算机应用》国际期刊( International Journal of Computer Applications)(0975 – 8887),第71期,第15篇,2013年5月。

- “Cicirelli, G. 和 D’Orazio, T., “Gesture Recognition by Using Depth Data: Comparison of Different Methodologies”,《运动追踪和手势识别》(Gonzalez, C.,编辑),2017年7月12日。DOI:10.5772/68118